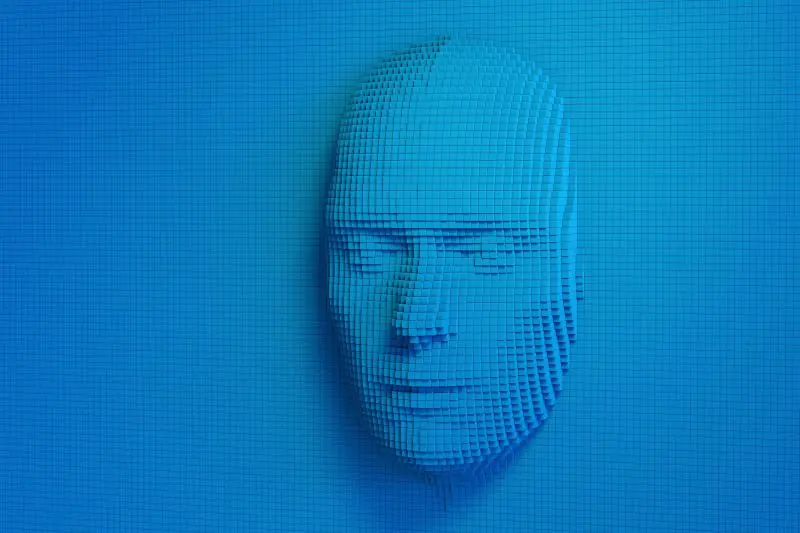

Regolamentare l’intelligenza artificiale è realmente possibile? Una riflessione è necessaria

Tempo di Lettura: 2 minuti Regolamentare l’intelligenza artificiale è possibile? una domanda che può apparire come una provocazione. Ma aprire una riflessione è quantomeno necessario. Se appena quarant’anni fa se qualcuno ci avesse descritto il processo esponenziale con cui la tecnologia avrebbe cambiato le nostre abitudini quotidiane probabilmente in pochi ci avrebbero creduto. In pochi avrebbero immaginato come sarebbero radicalmente […]

Regolamentare l’intelligenza artificiale è possibile? una domanda che può apparire come una provocazione. Ma aprire una riflessione è quantomeno necessario. Se appena quarant’anni fa se qualcuno ci avesse descritto il processo esponenziale con cui la tecnologia avrebbe cambiato le nostre abitudini quotidiane probabilmente in pochi ci avrebbero creduto. In pochi avrebbero immaginato come sarebbero radicalmente […]

![]()

Regolamentare l’intelligenza artificiale è possibile? una domanda che può apparire come una provocazione. Ma aprire una riflessione è quantomeno necessario.

Se appena quarant’anni fa se qualcuno ci avesse descritto il processo esponenziale con cui la tecnologia avrebbe cambiato le nostre abitudini quotidiane probabilmente in pochi ci

avrebbero creduto. In pochi avrebbero immaginato come sarebbero radicalmente cambiate le relazioni umane, come con un solo dispositivo saremmo riusciti a svolgere la maggior parte delle funzioni sociali. E questa realtà continua a cambiare sotto i nostri occhi a una velocità crescente.

Quando si parla della necessità di regolamentare l’intelligenza artificiale, dovremmo prima fermarci a riflettere di quale intelligenza artificiale vogliamo parlare. Di quell’embrione casalingo di intelligenza artificiale che risponde ancora a fatica alle nostre banali domande o che ci consente di giocare a modificare le nostre foto come se fossimo tutti perfetti fotoreporter? Di quella che ci consente di comunicare con un arabo o un giapponese in tempo reale, o che ci permette di processare enormi basi di dati, o dell’intelligenza artificiale dei mesi e degli anni a venire?

Mentre in questi mesi a Bruxelles si è parlato della prima legge sull’AI, questa intanto ha continuato a evolvere. E continuerà a farlo frattanto che entrerà in vigore il primo AI Act.

La politica, le istituzioni hanno fatto fin qui quanto di loro competenza, ma dobbiamo prendere atto che ci troviamo di fronte a un fenomeno senza precedenti e non facilmente controllabile. Un fenomeno che potrebbe in tempi relativamente brevi non essere

esclusivamente umano.

Negli anni quaranta del secolo scorso, lo scrittore visionario Isaac Asimov fu il primo a intravedere le minacce delle intelligenze artificiali. In uno dei suoi libri, che restano nella

storia dei classici di quella che allora era fantascienza, è stato il primo a parlare dell’esigenza di regole per robot dotati di autonomia. Nelle sue tre leggi della robotica, Asimov non descrive norme per gli umani e per chi crea i robot ma le scrive per macchine dotate di intelligenza superiore. Non è un pazzo: nei suoi libri esiste già una nuova razza superiore, quella degli umanoidi positronici.

Indipendentemente dal fatto che possano essere dotate o meno di sembianze antropomorfe, che in futuro possa imporsi una nuova categoria di “intelligenze” autonome diverse da quella umana è ormai più che una semplice ipotesi. Che questo possa portare una macchina o più macchine superintelligenti a governare il mondo ancora non è ancora dato saperlo.

Quello che sappiamo è però che già oggi esistono macchine capaci di eseguire alcuni compiti in modo autonomo e capaci di apprendere senza l’intervento umano. Questi sistemi possono diventare ancora più autonomi. Basterà una legge umana a controllarne o fermarne l’evoluzione? Il dubbio è legittimo…

Fonte foto IPA

![]()